Tối 9/6, nghệ sĩ Lý Hải lên tiếng cảnh báo về việc anh và gia đình bị mạo danh qua công nghệ AI (deepfake) nhằm phục vụ mục đích lừa đảo tinh vi, từ quảng cáo ứng dụng cờ bạc đến tuyển dụng việc làm tại nhà.

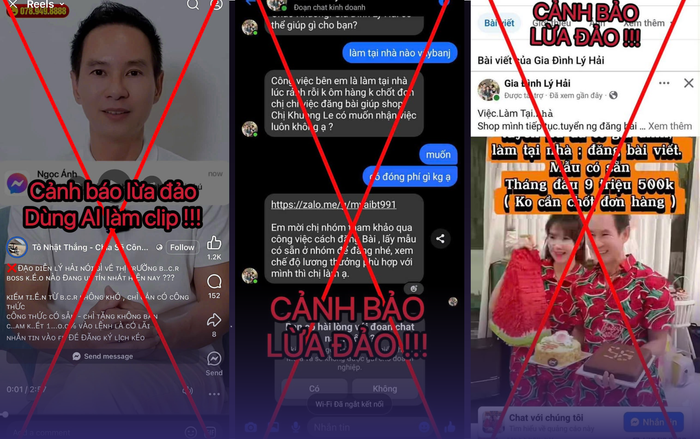

Trên trang Facebook chính thức, Minh Hà - vợ Lý Hải đăng tải bài viết kèm hình ảnh cho thấy một đoạn video giả mạo với hình ảnh và giọng nói giống hệt nam đạo diễn Lật Mặt. Trong video, "Lý Hải giả" được cho là đang giới thiệu một ứng dụng kiếm tiền trực tuyến và kêu gọi người xem tham gia. Đồng thời, nhiều tài khoản Facebook và Zalo giả mạo danh nghĩa gia đình Lý Hải cũng được phát hiện, mời gọi người dùng ứng tuyển công việc tại nhà với lời hứa hẹn dễ dàng, thu nhập cao.

"Clip giả mạo quá thật, giả luôn giọng nói. Mọi người hết sức cẩn thận nha!", Minh Hà chia sẻ và khẳng định chỉ có một fanpage chính thức có dấu tick xanh của cô và chồng.

Bên cạnh đó, cả hai cũng kêu gọi cộng đồng cùng báo cáo các nội dung giả mạo để tránh việc lan truyền thông tin sai lệch, ảnh hưởng đến uy tín cá nhân và gây nguy hiểm cho người dùng.

Bài đăng của vợ chồng Lý Hải nhanh chóng nhận về hàng ngàn lượt tương tác, với nhiều bình luận bày tỏ sự lo lắng và phẫn nộ. Không ít người cho biết họ cũng từng suýt trở thành nạn nhân khi nhận được tin nhắn giả mạo kêu gọi tham gia nhóm, nhấp vào đường link lạ.

Từ câu chuyện Lý Hải: Bài học để tự bảo vệ trước hiểm họa deepfake

Không chỉ riêng Lý Hải - Minh Hà, nhiều nghệ sĩ Việt cũng từng trở thành nạn nhân của deepfake. Những nghệ sĩ như Quyền Linh, Trấn Thành, Ninh Dương Lan Ngọc, Sơn Tùng,... cũng thường xuyên là nạn nhân của việc bị mạo danh, gây ảnh hưởng nghiêm trọng đến danh dự và hình ảnh cá nhân.

Deepfake - công nghệ tạo ra hình ảnh, video và giọng nói nhân tạo từng được kỳ vọng sẽ mở ra bước tiến trong ngành giải trí và truyền thông. Nhưng khi rơi vào tay kẻ xấu, công nghệ này đã nhanh chóng trở thành "vũ khí giả mạo" nguy hiểm. Chỉ cần vài đoạn video cũ hoặc dữ liệu công khai trên mạng, AI có thể dựng nên phiên bản "nhân vật ảo" gần như không thể phân biệt với thật, phục vụ mục đích lừa đảo, thao túng và đánh cắp lòng tin.

Bộ Thông tin và Truyền thông, Bộ Công an đều từng cảnh báo về các dấu hiệu nhận diện deepfake, từ hình ảnh không khớp khẩu hình đến giọng nói thiếu cảm xúc. Tuy nhiên, trong thực tế, phần lớn người dùng không có kỹ năng nhận biết và dễ bị dẫn dắt bởi nội dung "như thật".

Trước thực tế đó, nhiều chuyên gia an ninh mạng đã lên tiếng khuyến nghị người dùng cần trang bị kỹ năng số cơ bản để tự bảo vệ mình trước deepfake. Theo chuyên gia bảo mật Hiếu PC, một trong những cách nhận diện hiệu quả là yêu cầu người đang gọi video thực hiện các hành động ngẫu nhiên như nhe răng, quay đầu, hoặc nói một câu bất ngờ, bởi AI khó tái hiện biểu cảm phức tạp và phản xạ tự nhiên trong thời gian thực.

Ngoài ra, việc kiểm tra kỹ dấu tick xanh trên tài khoản mạng xã hội, không vội vàng chuyển tiền hay cung cấp thông tin cá nhân khi chưa xác minh đa kênh cũng là nguyên tắc cơ bản để giảm thiểu rủi ro bị lừa đảo qua công nghệ giả mạo.