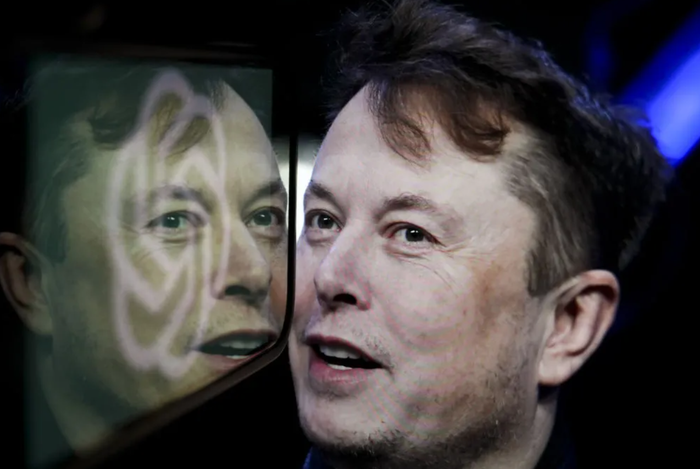

Nỗ lực pháp lý của Elon Musk nhằm giải thể OpenAI có thể phụ thuộc vào việc công ty con vì lợi nhuận của nó đóng góp hay làm suy yếu sứ mệnh ban đầu của phòng thí nghiệm tiên phong này, đó là đảm bảo nhân loại được hưởng lợi từ trí tuệ nhân tạo tổng quát.

Ngày 7/5, một tòa án liên bang tại Oakland đã nghe lời khai từ cựu nhân viên kiêm thành viên hội đồng quản trị cho rằng việc đẩy mạnh thương mại hóa các sản phẩm AI đã làm suy giảm cam kết về an toàn của OpenAI.

Rosie Campbell gia nhập nhóm “sẵn sàng AGI” của OpenAI vào năm 2021 và rời công ty năm 2024 sau khi nhóm này bị giải thể. Một nhóm khác tập trung vào an toàn AI là Super Alignment cũng bị đóng cửa trong cùng giai đoạn.

“Từ khi tôi gia nhập, công ty tập trung rất nhiều vào nghiên cứu và mọi người thường xuyên thảo luận về AGI cũng như các vấn đề an toàn. Nhưng theo thời gian, OpenAI trở nên giống một tổ chức tập trung vào sản phẩm hơn”, cô khai trước tòa.

Theo Campbell, việc phát triển AGI chắc chắn cần nguồn tài chính rất lớn. Tuy nhiên, cô cho rằng việc tạo ra các mô hình siêu trí tuệ khi chưa có đủ cơ chế an toàn phù hợp sẽ đi ngược lại sứ mệnh ban đầu của tổ chức. Cựu nhân viên này cũng nhắc đến sự cố Microsoft triển khai GPT-4 tại Ấn Độ thông qua Bing trước khi mô hình được Hội đồng An toàn Triển khai của OpenAI đánh giá đầy đủ. Dù không xem đây là rủi ro nghiêm trọng, Campbell cho rằng sự việc cho thấy các quy trình an toàn có nguy cơ bị xem nhẹ khi công nghệ phát triển quá nhanh.

Trong phần thẩm vấn chéo, các luật sư của OpenAI yêu cầu Campbell thừa nhận rằng, theo quan điểm cá nhân của cô, cách tiếp cận an toàn của OpenAI hiện vẫn tốt hơn xAI - công ty AI do Musk sáng lập.

OpenAI hiện vẫn công khai các báo cáo đánh giá mô hình và khung an toàn AI. Tuy nhiên, công ty từ chối bình luận về chiến lược điều chỉnh AGI hiện tại. Hồi tháng 2, OpenAI tuyển Dylan Scandinaro từ Anthropic để dẫn dắt bộ phận “preparedness”. CEO Sam Altman từng nói việc tuyển dụng này khiến ông “ngủ ngon hơn vào ban đêm”.

Những tranh cãi về an toàn AI cũng liên quan trực tiếp đến cuộc khủng hoảng nội bộ từng làm rung chuyển OpenAI vào năm 2023. Khi đó, hội đồng quản trị phi lợi nhuận của công ty bất ngờ sa thải tạm thời Altman vì lo ngại ông thiếu minh bạch trong quản lý.

Sự việc xảy ra sau khi nhiều lãnh đạo cấp cao, trong đó có Ilya Sutskever và Mira Murati, bày tỏ lo ngại về phong cách điều hành né tránh xung đột của Altman.

Tasha McCauley - thành viên hội đồng quản trị thời điểm đó cho biết hội đồng dần mất niềm tin vì không chắc những thông tin nhận được từ ban lãnh đạo đã đầy đủ để đưa ra quyết định. McCauley cũng nhắc lại hàng loạt tranh cãi nội bộ, trong đó có việc Altman bị cho là không thông báo trước với hội đồng về kế hoạch ra mắt ChatGPT. Ngoài ra, ông còn bị cáo buộc không minh bạch về các xung đột lợi ích tiềm ẩn.

“Chúng tôi là một hội đồng phi lợi nhuận và nhiệm vụ của chúng tôi là giám sát công ty vì lợi nhuận phía dưới. Nhưng khả năng đó đã bị đặt dấu hỏi. Chúng tôi không đủ tin tưởng rằng những thông tin nhận được là đầy đủ để đưa ra quyết định chính xác”, McCauley nói trước tòa.

Tuy nhiên, quyết định sa thải Altman diễn ra đúng lúc OpenAI triển khai chương trình mua cổ phần dành cho nhân viên. Khi phần lớn nhân viên đứng về phía Altman và Microsoft thúc đẩy khôi phục bộ máy cũ, hội đồng cuối cùng phải đảo ngược quyết định, còn các thành viên phản đối Altman thì rời vị trí.

Việc hội đồng phi lợi nhuận không thể kiểm soát công ty vì lợi nhuận là một phần quan trọng trong vụ kiện của Musk. Tỷ phú này cho rằng việc OpenAI chuyển từ tổ chức nghiên cứu sang một trong những công ty tư nhân lớn nhất thế giới đã phá vỡ thỏa thuận ngầm giữa các nhà sáng lập.

David Schizer - cựu hiệu trưởng Trường Luật Columbia Law School và hiện là nhân chứng chuyên gia do phía Musk thuê cũng đồng tình với những lo ngại trên.

“OpenAI luôn nhấn mạnh rằng an toàn là trọng tâm sứ mệnh và họ sẽ ưu tiên an toàn hơn lợi nhuận. Điều quan trọng là quy trình phải được tuân thủ nghiêm túc”, ông nói.

McCauley cho rằng những thất bại trong cơ chế quản trị nội bộ tại OpenAI cho thấy cần có quy định mạnh tay hơn từ chính phủ đối với AI tiên tiến. Theo bà, nếu mọi quyết định cuối cùng đều phụ thuộc vào một CEO trong khi lợi ích công chúng bị đặt cược, đó là một mô hình cực kỳ không tối ưu.