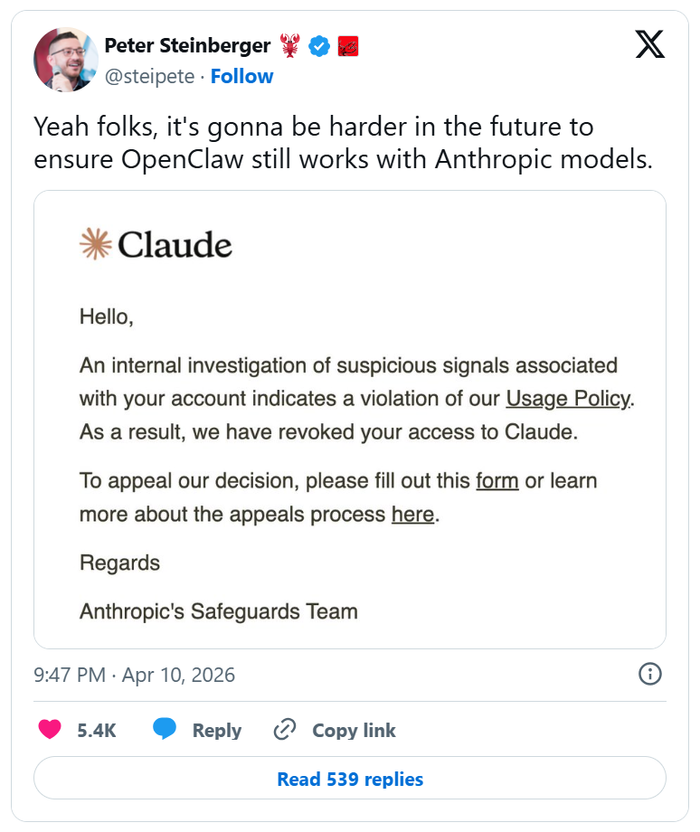

“Vâng mọi người, trong tương lai sẽ khó hơn để đảm bảo OpenClaw vẫn hoạt động tốt với các mô hình của Anthropic”, nhà sáng lập OpenClaw Peter Steinberger đăng trên X, kèm theo ảnh một thông báo từ Anthropic cho biết tài khoản của anh đã bị đình chỉ vì hoạt động đáng ngờ.

Lệnh cấm này không kéo dài lâu. Vài giờ sau, khi bài đăng lan truyền, Steinberger cho biết tài khoản của anh đã được khôi phục. Trong hàng trăm bình luận, nhiều ý kiến mang tính suy đoán rằng, do Steinberger hiện làm việc cho đối thủ của Anthropic là OpenAI. Trong đó có một bình luận từ một kỹ sư của Anthropic. Người này nói rằng công ty chưa từng cấm ai chỉ vì dùng OpenClaw và đề nghị hỗ trợ.

Hiện chưa rõ điều đó có phải là yếu tố giúp tài khoản được khôi phục hay không. Nhưng toàn bộ chuỗi sự việc đã hé lộ nhiều khía cạnh đáng chú ý.

Vụ cấm này diễn ra sau thông tin tuần trước rằng các gói đăng ký Claude của Anthropic sẽ không còn bao gồm các công cụ bên thứ ba như OpenClaw, theo công ty AI này.

Người dùng OpenClaw giờ đây phải trả phí riêng cho việc sử dụng thông qua API của Claude. Về bản chất, Anthropic vốn có sản phẩm agent riêng là Cowork đang áp dụng một “thuế claw”.

Steinberger cho biết anh đã tuân thủ quy định mới và sử dụng API, nhưng vẫn bị khóa tài khoản.

Anthropic giải thích rằng thay đổi này là do gói thuê bao không được thiết kế cho các kiểu sử dụng của claw. Các công cụ dạng này tiêu tốn nhiều tài nguyên hơn prompt thông thường vì có thể chạy vòng suy luận liên tục, tự động lặp lại nhiệm vụ và kết nối nhiều công cụ bên thứ ba.

Tuy nhiên, Steinberger không đồng tình. Sau khi thay đổi giá, anh đăng rằng: “Thật thú vị khi thời điểm trùng hợp, đầu tiên họ sao chép một số tính năng phổ biến vào hệ thống đóng, rồi sau đó chặn các giải pháp mã nguồn mở.” Dù không nói rõ, anh có thể ám chỉ các tính năng trong agent Cowork của Anthropic như Claude Dispatch, cho phép điều khiển từ xa và giao nhiệm vụ cho AI. Tính năng này được tung ra vài tuần trước khi Anthropic thay đổi chính sách giá với OpenClaw.

Một người bình luận cho rằng lỗi thuộc về anh vì đã chọn làm việc cho OpenAI thay vì Anthropic, viết: “Anh đã có lựa chọn nhưng lại chọn sai.” Steinberger đáp lại: “Một bên chào đón tôi, bên còn lại gửi thư đe dọa pháp lý.”

Khi nhiều người hỏi tại sao anh vẫn dùng Claude thay vì mô hình của công ty mình, anh giải thích rằng chỉ dùng để kiểm thử, nhằm đảm bảo OpenClaw hoạt động ổn định với người dùng Claude.

Anh nói: “Bạn cần tách biệt hai việc: công việc của tôi tại OpenClaw Foundation nhằm đảm bảo OpenClaw hoạt động tốt với mọi nhà cung cấp mô hình, và công việc tại OpenAI để hỗ trợ chiến lược sản phẩm tương lai.”

Nhiều người cũng chỉ ra rằng việc cần kiểm thử Claude là vì đây vẫn là lựa chọn phổ biến của người dùng OpenClaw hơn cả ChatGPT. Steinberger phản hồi: “Đang xử lý.”